在人工智能的浪潮中,大模型技术以其强大的数据处理能力和多任务处理能力,成为推动社会进步的关键力量。然而,随着大模型技术的快速发展,其安全性问题也日益凸显。阿里云计算有限公司与中国信息通信研究院联合发布的《大模型安全研究报告(2024年)》深入探讨了大模型的安全风险,并展望了其在未来的应用前景。

大模型技术的发展与挑战

大模型技术经历了从预训练语言模型的探索期,到语言大模型的爆发期,再到多模态大模型的提升期。这一技术的发展不仅标志着智能水平的显著提升,也预示着人机交互方式和应用研发模式的重大变革。然而,大模型的商业化应用和产业化落地也带来了新的安全风险,如模型“幻觉”、指令注入攻击、网络攻击平民化等。

大模型的安全风险

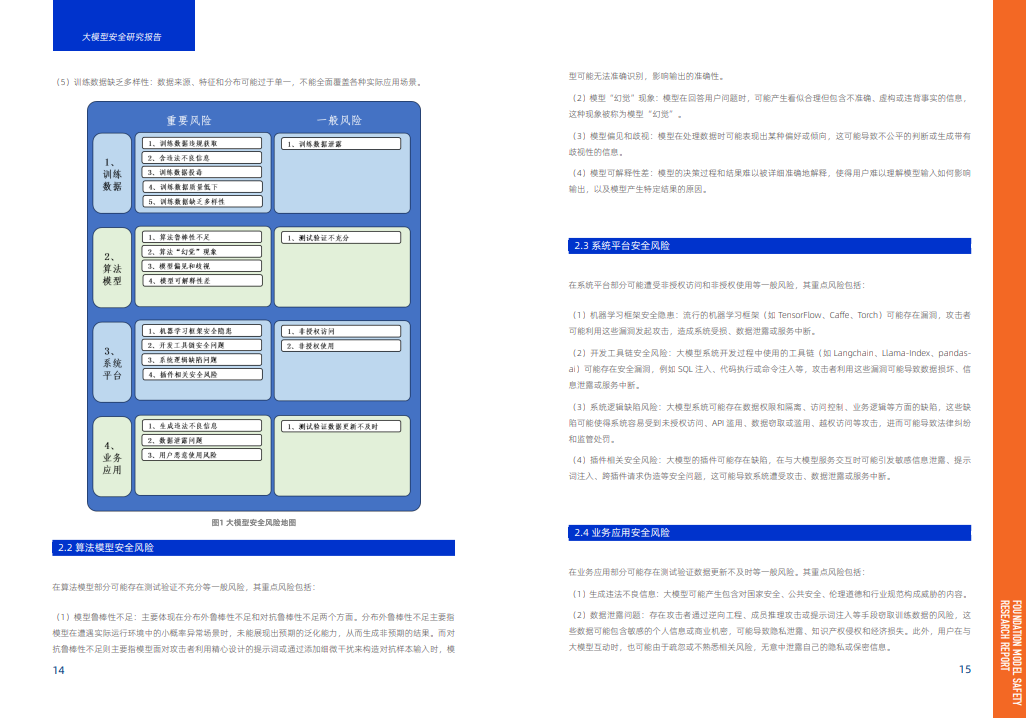

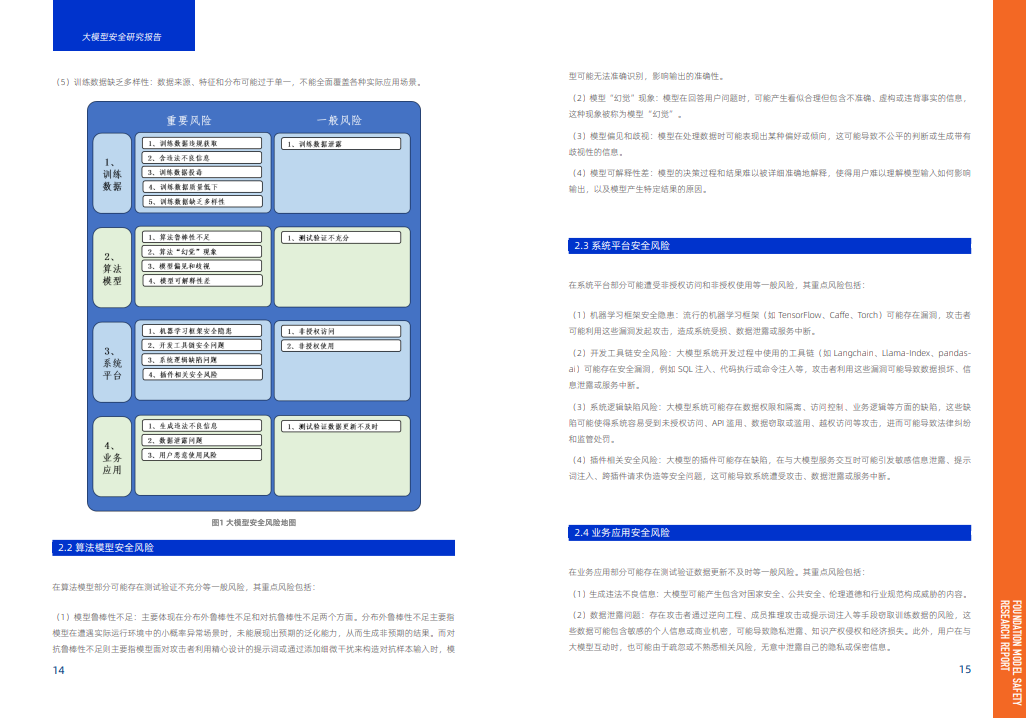

报告指出,大模型的安全风险主要集中在训练数据、算法模型、系统平台和业务应用四个方面。训练数据可能存在泄露、违法不良信息、投毒等问题;算法模型可能存在鲁棒性不足、“幻觉”现象、偏见和歧视、可解释性差等问题;系统平台可能面临非授权访问和使用的风险;业务应用可能产生违法不良信息、数据泄露和用户恶意使用的风险。

大模型安全框架

为有效防范和消减大模型的安全风险,报告提出了大模型自身安全框架,涵盖安全目标、安全属性、保护对象、安全措施四个方面。这一框架旨在为社会各方提供有益参考,共同推动大模型技术产业的健康发展。

大模型赋能安全

大模型技术在网络安全、数据安全、内容安全等领域展现出巨大应用潜力。在网络安全领域,大模型可应用于风险识别、安全防御、安全检测、安全响应、安全恢复等多个保护环节。在数据安全领域,大模型可应用于数据分类分级、APP(SDK)违规处理个人信息检测等场景。在内容安全领域,大模型可应用于文本、图像视频、音频内容安全检测等场景。

大模型技术产业展望

报告展望了大模型技术的未来,预计大模型将从实现与人类社会无障碍交互,跃迁至深刻理解并有效改造数字世界和物理世界的阶段。大模型产业将从单一的技术研究转向全面赋能各行业及催生新兴领域的转型之路。

大模型自身安全展望

随着大模型技术能力的日益增强,其对国家社会秩序的冲击也不容忽视。报告提出,未来需从构建层次化治理体系和创新安全保护技术两个方面同时发力,以全面有效应对大模型安全风险。

大模型赋能安全展望

短期内,大模型将显著提升现有安全技术的性能和智能化水平。长期来看,大模型有潜力成为安全防护的核心,从而改变安全的工作模式,从依赖安全人员调度和使用安全工具,转变为以大模型为核心调度并智能化使用安全工具。

大模型技术的发展带来了前所未有的机遇和挑战。《大模型安全研究报告(2024年)》为我们提供了一个全面的视角,从安全风险的识别到未来应用的展望,为大模型技术的健康发展提供了宝贵的指导和建议。让我们共同关注大模型技术的安全问题,携手推动这一技术的安全、稳健发展。

关注公众号,回复“大模型安全研究报告2024”可以获取完整下载地址

来源:阿里云计算有限公司与中国信息通信研究院

【免责声明】本文内容基于大模型安全研究报告2024年,旨在传递更多信息,不代表本公众号赞同其观点和对其真实性负责。如涉及版权等问题,请及时联系我们。

大模型扫盲系列——初识大模型

大模型发展的十大挑战与十大展望

一文彻底搞懂大模型 - LLM四阶段技术

神经网络算法 - 一文搞懂Transformer

大数据技术概况

深度学习、神经网络与卷积神经网络:研究及应用

《工业大模型应用报告》重磅发布|可下载

兴趣驱动、能力导向、价值引领的Python语言程序设计课程创新与实践

2025年人工智能十大趋势!最新预测→

北京市教育领域人工智能应用工作方案发布

一文搞懂深度学习:神经网络基础